①国内首个全绿电供应虚拟电厂项目近日在浙江宁波东方电缆园区正式投入运行

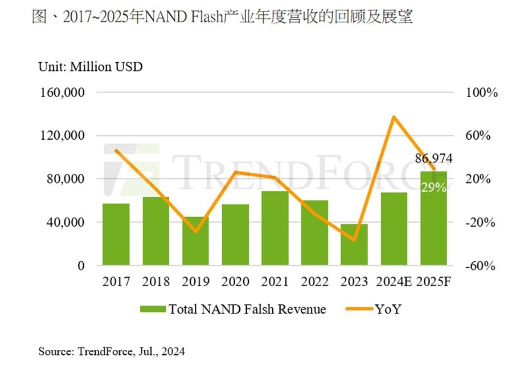

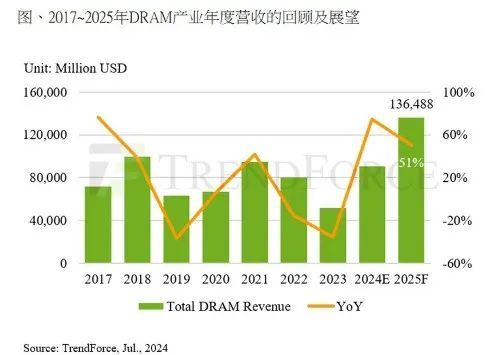

据集邦咨询消息,因为供需关系改善,需求上涨,HBM 内存的冲击,预估 DRAM 内存以及 NAND 闪存在 2024 年营收增幅分别达到 75% 和 77%。

来源:集邦咨询

而 DRAM 内存在 2025 年营收幅度将继续增长至 51%,2024 年、2025 年营收分别达到 907 亿美元以及 1365 亿美元,创下历史新高。

来源:集邦咨询

受需求增长关系,DRAM 均价在 2024 年以及 2025 年整体价格将分别上涨 53% 和 35%。

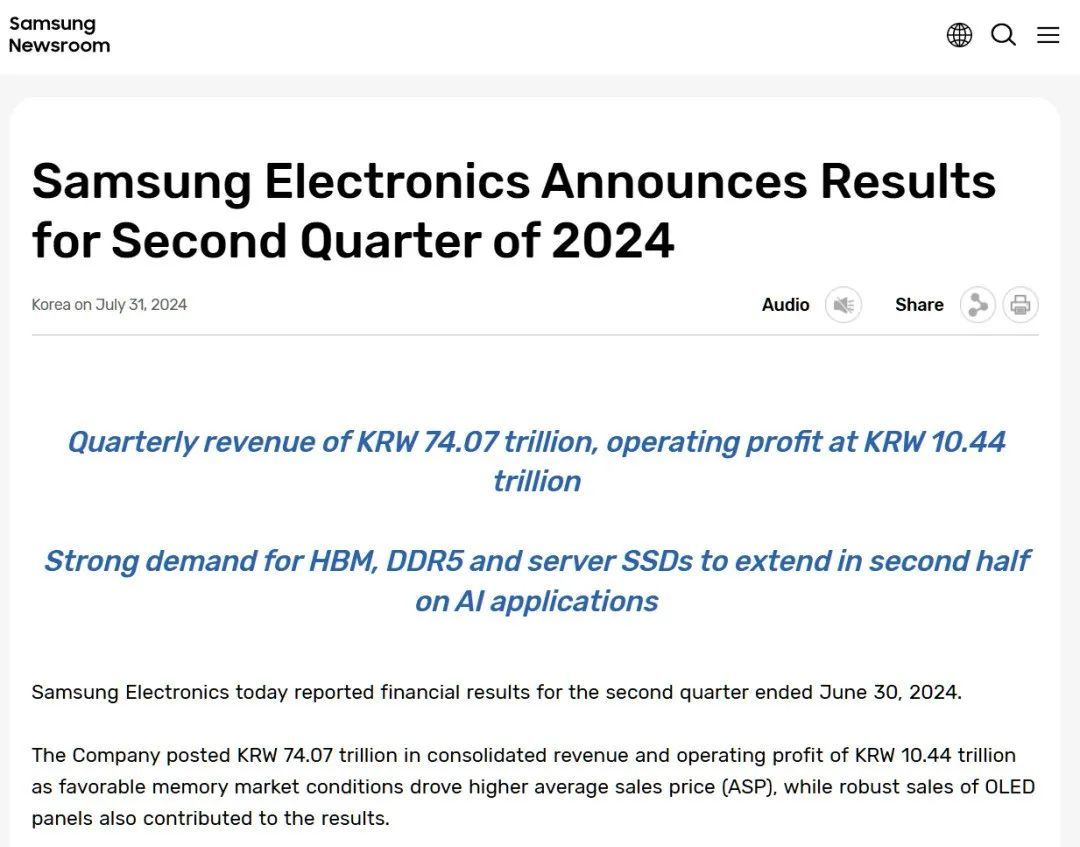

而另一方面,三星最近也公布了 Q2 季度的营收,因为 AI 的繁荣提高了半导体部门的收益;

以及 2023 年 4 月掀桌子减产 50% 提价的措施,三星实现了 2010 年以来最快的利润增幅。

来源:Samsung

利润营收达到了 10.44 万亿韩元,折合人民币 549.1 亿元,利润增速达到 1458%。

三星表示赚麻了,还要加大 AI 行业投入。

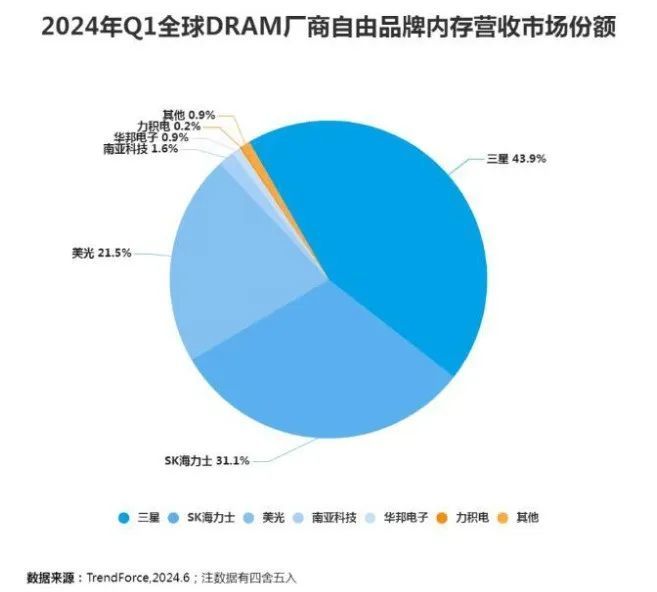

那看到这可能有同学要举手了,这内存和闪存不是一片欣欣向荣吗?为啥要涨价?而且为啥单独提三星呢?

咱们先看 2024 年 Q1 的 DRAM 的市场份额,三星独领风骚占比 43.9%,是实打实内存市场的风向标。

来源:TrendForce

另外一点就是咱们之前提到的 HMB 内存了,其实很多玩电脑的同学对这个已经不陌生了。

它主要运用在显卡上面,之前在消费级咱们能接触到的典型就是 AMD 的 Vega 64 和 Vega 56 这两款显卡。

来源:微星

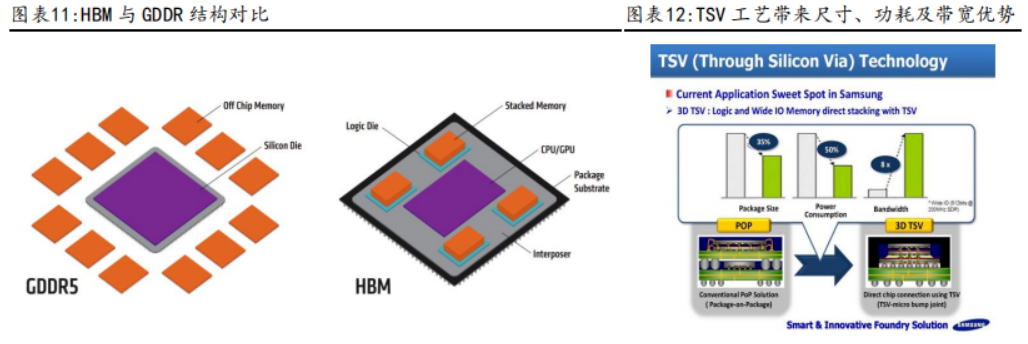

可以看到,相较于传统的 GDDR 显存,HBM 可以通过立体堆栈的方式获得获得更大的位宽,从而大幅度提升显存带宽。

来源:AMD&Samsung

我们知道,显存的带宽 = 位宽 x 频率 / 8,提升频率相当困难的情况下,那相对应的增加位宽就是解决带宽不够的较容易途径了。

但它的缺点就是制造工艺复杂成本过高,不适用普通的设备。所以 AMD 后来也就没有再坚持使用。

但面对 AI 庞大的计算量,高带宽的显存就必不可少了。

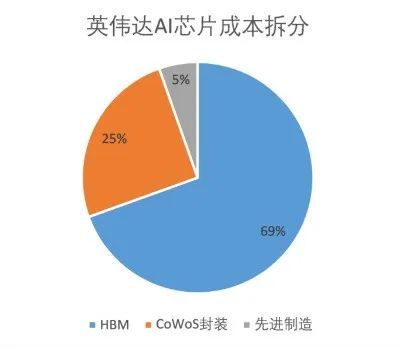

而我们的老朋友 NVIDIA 的最新显卡用于 AI 计算领域的 H200 就采用的是 HBM3E 显存。

来源:JRB数据统计

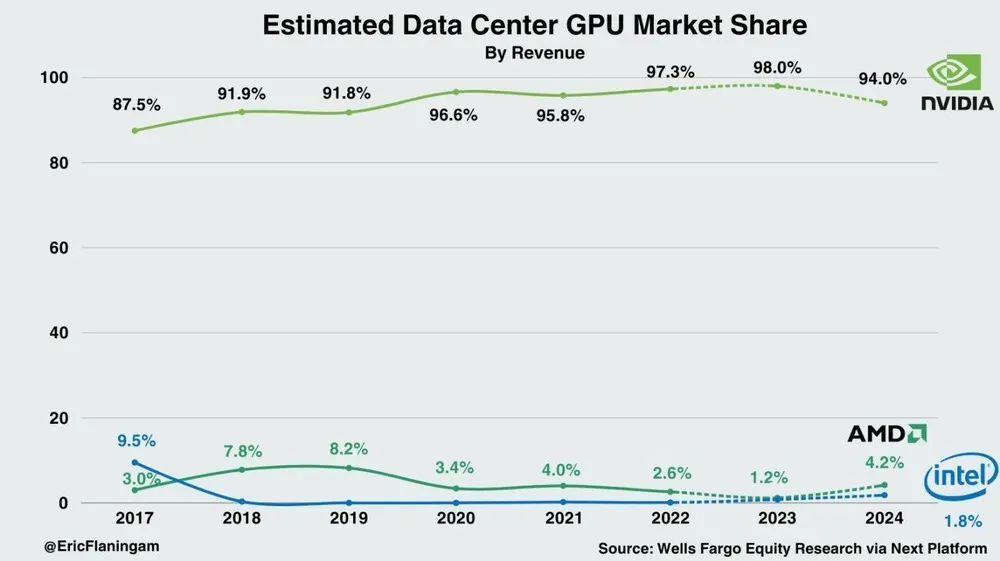

并且众所周知,NVIDIA 在 2022 年矿潮结束以后,转头就加大了 AI 领域的投入,并且在 AI 上面处于垄断式的领先,而如今大部分的精力和产能都在 AI 上面。

数据中心份额占比,来源:Revenue

那么相对应的,HBM 需求和产能增加,挤占传统存储颗粒的产能,从而也就使 DRAM 其他领域产能紧俏。

然后就是三星的后院“起火“了。

相信关注科技圈比较多的同学已经知道了,三星在 7 月爆发了最大规模的罢工运动;

人数达到 6540 名员工,其中半导体相关岗位就达到 5211 人。如此规模势必要对生产工作产生较大的冲击。

并且最新的消息是,三天的最终谈判,谈崩了。

三星电子全国工会 NSEL(罢工方)宣布,由于谈判破裂,他们将继续无限期罢工,目前双方陷入僵局。

综上来看,一方面是 AI 行业的 HBM 挤占传统 DRAM 产能,另一方面因为三星罢工引起的产能受阻。

消费级存储颗粒价格真的要迎来飞涨股票t+o交易平台,从而影响内存价格,这下留给等等党的时间已经不多了。